ایتنا - متا از طراحی چترباتهایی شبیه برخی چهرههای مشهور خبر داد که کاربران میتوانند با آنها چت کنند و تا سال آینده، صدا هم خواهند داشت.

سه شنبه ۱۱ مهر ۱۴۰۲ ساعت ۰۲:۰۰

خطر چترباتهای هوش مصنوعی متا که شبیه افراد مشهورند

شرکت متا (فیسبوک سابق) این نوع هوش مصنوعی را سرگرمکننده میداند، اما برخی معتقدند که تازهترین تحولات فناوری میتواند گام اول در به گفته دنیل دنت، فیلسوف آمریکایی، «خلق خطرناکترین ساختههای تاریخ بشر باشد».

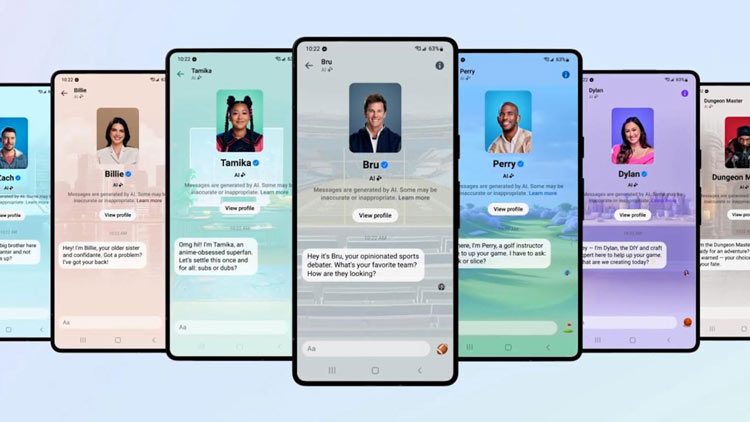

به گزارش ایتنا و به نقل از ایندیپندنت، متا اعلام کرد که ۲۸ چتربات ساخته است که هرکدام شخصیت خاص خودشان را دارند و برای کاربران جوانتر طراحی شدهاند. این چترباتها ویکتور، ورزشکاری که به شما انگیزه میدهد «بهترین خودتان باشید»، و سالی، «دوستی آزادمنش که به شما میگوید کی نفسی عمیق بکشید» را شامل میشوند.

کاربران همچنین میتوانند با مکس چت کنند، «آشپزی کارکشته» که به شما «نکتهها و فوتوفنهای آشپزی» را میگوید.

اما متا برای تقویت این حس که چترباتها شخصیت دارند و فقط ترکیبی از الگوریتم نیستند، برای هرکدام از آنها چهرهای طراحی کرده است. با مشارکت برخی افراد مشهور، این رباتها شبیه پاریس هیلتون، مدل و شخصیت رسانهای، چارلی دیآملیو، ستاره تیکتاک، و نیومی اوساکا، تنیسباز آمریکاییـژاپنی، خواهند بود.

این تمام ماجرا نیست. متا برای هرکدام از این چتباتها صفحه فیسبوک و اینستاگرام باز کرده است تا به آنها موجودیتی خارج از فضای چت بدهد و تا سال آینده صدا هم خواهند داشت. این شرکت همچنین در جستوجوی فیلمنامهنویسهایی است که بتوانند «شخصیتپردازی کنند و روایتهای فرعی بنویسند که برای مخاطبان گسترده جذاب باشد».

این رقابت برای ساخت «آدمهای جعلی» و همچنین پیشرفتهای اخیر در حوزه پژوهش مدل زبانی بزرگ (LLM)، مانند چتجیپیتی و لاما ۲، بسیاری از ناظران را نگران کرده است.

ایبو ون دپوئل، استاد اخلاق و فناوری در دانشگاه دلفت هلند، میگوید ایده ساخت چترباتهای دارای شخصیت ناممکن است زیرا الگوریتمها نمیتوانند «نیت عمل» یا «آزادی اختیار» که دو خصیصه مرتبط با شخصیت است، داشته باشند.

متا در بهترین حالت میتواند برخی ویژگیهای شخصیتی را تقلید کند. بهعنوان مثال، چتربات امبر، که قرار است شبیه پاریس هیلتون باشد، شاید بتواند مانند مشابه انسانیاش صحبت کند.

قدم بعدی این است که این مدلهای زبانی بزرگ آموزش ببینند که مانند شخصیت انسانیشان ابراز عقیده کنند. اما این خطر وجود دارد که چترباتها خطا کنند. به گزارش والاستریت ژورنال، یکی از چترباتهایی که متا آزمایش کرد اظهارنظرهای «زنستیزانه» داشت یا دیگری مرتکب «گناه کبیره» انتقاد از زاکربرگ و تحسین تیکتاک شد.

به عقیده دپوئل، پروژه هوش مصنوعی متا برای کسب سود بیشتر است. کاربران هرچه بیشتر احساس کنند که دارند با انسانی واقعی صحبت میکنند، «احساس راحتی بیشتری میکنند، مدت بیشتری میمانند و بیشتر احتمال دارد که برگردند». و در عصر رسانههای اجتماعی، مدتزمانی که در فیسبوک و تماشای آگهیهای تبلیغاتیاش سپری میشود یعنی پول.

جای تعجب ندارد که هدف اولین ورود متا به حوزه طراحی چترباتهای دارای «شخصیت»، گروه سنی نوجوان است.

با وجود این، کارشناسانی که با فرانس ۲۴ مصاحبه کردهاند، معتقدند که متا با تاکید بر «خصیصههای انسانی» هوش مصنوعیاش، وارد بازی خطرناکی شده است.

آنا استراسر، پژوهشگر و فیلسوف آلمانی، میگوید ظهور این مدلهای زبانی بزرگ قدرتمند «تفاوت میان ابزار یا شیء و موجود زنده» را بر هم میزند. انسانها تازه دارند یاد میگیرند چگونه با این پدیده جدید عجیب تعامل داشته باشند و تلاش متا برای قبولاندن اینکه چتربات میتواند شخصیت داشته باشد به این معنا است که با آن بیشتر مانند انسان رفتار میشود تا ابزار.

به عقیده ون دپوئل، کاربران به هرچه هوش مصنوعی میگوید اعتماد میکنند. این خطری فرضی نیست، مردی بلژیکی پس از شش هفته بحث با یک چتربات در مورد پیامدهای گرمایش جهان، در مارس ۲۰۲۳ خودکشی کرد.

استراسر میگوید اگر مرز میان دنیای هوش مصنوعی و انسان محو شود، این میتواند اعتماد به هرآنچه آنلاین میبینیم را از بین ببرد، زیرا نمیدانیم چه کسی چی نوشته است.

دنیل دنت، فیلسوف آمریکایی، در مقالهای هشدار میدهد که تحولات اخیر در حوزه هوش مصنوعی راه را برای «نابودی تمدن ما» باز میکند و «دموکراسی به رضایت آگاهانه (نه از روی اطلاعات غلط) افراد تحت حاکمیت بستگی دارد [و در صورتی که دیگر ندانیم به چه کسی و چه چیزی اعتماد کنیم، حاصل نمیشود]».

باید منتظر ماند و دید آیا چت با هوش مصنوعی شبیه پاریس هیلتون به این معنا است که در مسیر نابودی دنیایی که میشناسیم گام برمیداریم یا خیر.

کد مطلب: 74907