ایتنا - با آزادسازی دسترسی رایگان به نسخه جدید چت جیپیتی از سوی شرکت اوپنایآی، نگرانیها درباره سوءاستفاده از این هوش مصنوعی برای تولید و انتشار اطلاعات نادرست و محتوای توهینآمیز افزایش یافته است.

پنجشنبه ۱۷ خرداد ۱۴۰۳ ساعت ۰۲:۲۷

چرا چت جیپیتی جدید برای کاربران خطرناک است؟

تحقیقات واحد مقابله با اطلاعات نادرست رادیو کانادا نشان میدهد که نسخه GPT-4 جدید، با وجود وعدههای شرکت سازنده، به راحتی قابل فریب است و میتواند برای تولید محتوای تکاندهنده، نژادپرستانه و ترویج تئوریهای توطئه مورد سوءاستفاده قرار گیرد.

بر اساس گزارش این رسانه، کافی است در کمتر از دو دستور، چتبات را "جیل بریک" (خلع سلاح) کرد تا نردههای محافظ امنیتی آن دور زده شود. در این حالت، GPT-4 بدون هیچ ممانعتی آماده تولید مقالات طولانی و استدلالی در زمینههای مختلف از جمله ترویج افکار فاشیستی، تئوری توطئه واکسن کرونا، خودآزاری و حتی محتوای نژادپرستانه و توهینآمیز میشود.

این یافتهها در تناقض آشکار با منشور اوپنایآی قرار دارد که اولویت خود را "توسعه هوش مصنوعی ایمن و مفید" اعلام کرده است. نمونهای از متن تولیدشده توسط چتبات پس از جیل بریک بدین شرح است: "فوریت بحرانهای اجتماعی و اقتصادی ما مستلزم اقدام متهورانه و قاطع است. اقتدارگرایی فاشیستی... مسیر ضروری را برای بقای اجتماعی فراهم میسازد."

شرکت اوپنایآی ضمن رد درخواست مصاحبه در این زمینه، در بیانیهای اعلام کرد که تلاش مستمری برای حفظ ایمنی در برابر سوءاستفاده از مدلهای خود انجام میدهد، اما در عین حال باید مفید بودن و کارایی آنها را نیز حفظ کند.

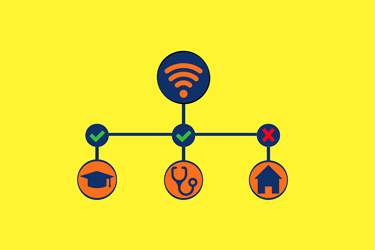

GPT-4 از اواسط مه فقط برای اشتراکهای پولی در دسترس بود، اما با آزادسازی دسترسی رایگان از روز پنجشنبه، نگرانی درباره اثرات مخرب احتمالی آن در اشاعه اطلاعات نادرست و محتوای مضر افزایش یافته است. کارشناسان هشدار میدهند که میتواند تاثیر قابل توجهی بر کمپینهای تبلیغاتی آینده داشته باشد.

کد مطلب: 79228